Pranam Shetty

Rochester, NY

Développeur IA. Ingénieur ML. J'affine des modèles, construis des pipelines évolutifs et automatise des flux de travail.

Avec Quoi Je Travaille

Expérience

Stagiaire Ingénieur IA

Mai 2024 - Août 2025

États-Unis

Conçu et mis en œuvre un pipeline d'évaluation comparative de LLM de bout en bout et une plateforme publique (présentée par FT et CNBC) pour évaluer la performance des modèles sur les tâches du CFA Niveau III en utilisant des cadres rigoureux et des stratégies de prompting avancées.

Stagiaire Ingénieur ML

Juin 2023 - Août 2023

Inde

Développé un moteur de signaux de trading en temps réel et un pipeline de fonctionnalités multimodal (Ichimoku + FinBERT) sur Kubernetes, améliorant le débit de 70% et la précision des prédictions de 15% dans des conditions de marché volatiles.

Stagiaire Recherche ML

Sept 2021 - Nov 2021

Inde

Réarchitecturé un pipeline Spark ML distribué réduisant le temps d'exécution de 75% et modernisé l'évaluation des risques pour plus de 500K réclamations quotidiennes, permettant un scoring en quasi temps réel via Docker et Kubernetes.

Stagiaire Analyse SEO

Fév 2020 - Mars 2020

Inde

Dirigé la transition vers la publicité numérique pendant la pandémie, optimisant les stratégies publicitaires Google/Facebook et utilisant l'analytique pour augmenter les conversions des cours éducatifs.

Contributeur Open Source

Juin 2024 - Maintenant

J'essaie activement de contribuer à l'Open Source sur mon GitHub

Projets

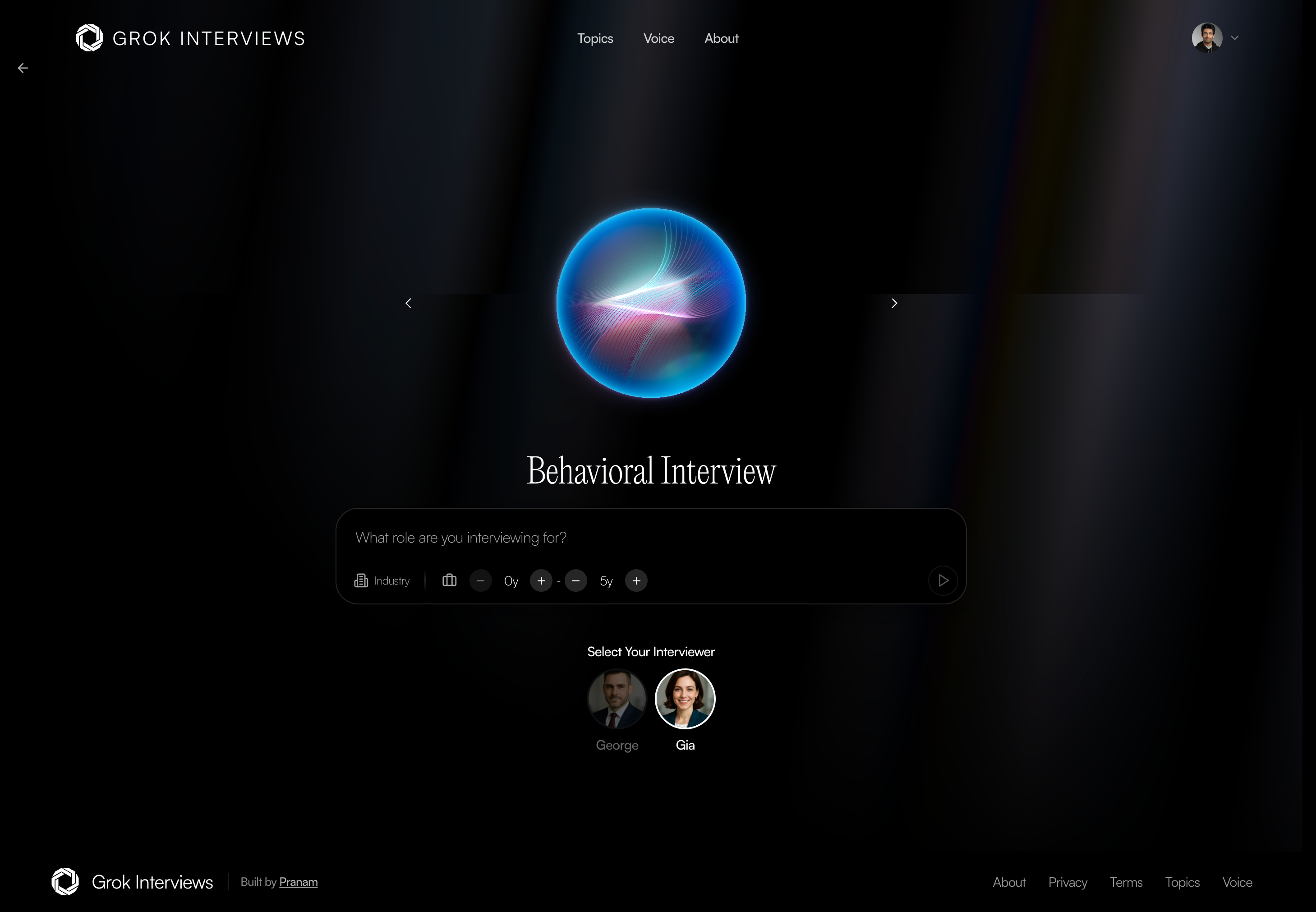

Grok Interviews

Une plateforme de préparation aux entretiens de qualité professionnelle comprenant plus de 3,6 millions de ressources organisées et 81 499 questions techniques dans 5 domaines majeurs.

Hugo Noir

Un thème propre et minimaliste pour Hugo axé sur la lisibilité, la simplicité et le support multilingue.

Blogs

2026-02-03

Planification Orientée Agent : Comment Faire Fonctionner Réellement l'IA Multi-Agents

Les systèmes d'IA multi-agents promettent de résoudre des problèmes complexes du monde réel — mais seulement si l'équipe d'agents spécialisés est correctement coordonnée…

2025-09-07

L'Attention N'Est Pas Tout Ce Dont Vous Avez Besoin. C'Est Comment Vous En Avez Besoin.

Jet-Nemotron repense l'IA en utilisant l'attention seulement quand nécessaire, augmentant dramatiquement la vitesse et la précision par rapport aux modèles traditionnels à attention complète.

2025-08-23

Les LLM sont-ils inutilement énormes ? Compression extrême des LLMs utilisant des réseaux tensoriels inspirés de la physique quantique

Présente une nouvelle approche appelée CompactifAI par Multiverse Computing, qui utilise des réseaux tensoriels inspirés de la physique quantique pour compresser drastiquement les LLMs avec une perte minimale de précision.