Pranam Shetty

Rochester, NY

Desarrollador de IA. Ingeniero ML. Ajusto modelos, construyo canalizaciones escalables y automatizo flujos de trabajo.

Con Qué Trabajo

Experiencia

Pasante de Ingeniero de IA

Mayo 2025 - Agosto 2025

Estados Unidos

Diseñé e implementé un pipeline de evaluación comparativa de LLM de extremo a extremo y una plataforma pública (destacada por FT y CNBC) para evaluar el rendimiento de modelos en tareas de CFA Nivel III utilizando marcos rigurosos y estrategias de prompting avanzadas.

Becario Ingeniero ML

Junio 2023 - Agosto 2023

India

Desarrollé un motor de señales de trading en tiempo real y un pipeline de características multimodal (Ichimoku + FinBERT) en Kubernetes, mejorando el rendimiento en un 70% y la precisión de predicción en un 15% bajo condiciones de mercado volátiles.

Becario de Investigación ML

Sept 2021 - Nov 2021

India

Re-arquitecté un pipeline distribuido de Spark ML reduciendo el tiempo de ejecución en un 75% y modernicé la evaluación de riesgos para más de 500K reclamaciones diarias, permitiendo puntuación casi en tiempo real vía Docker y Kubernetes.

Becario de Análisis SEO

Feb 2020 - Marzo 2020

India

Lideré la transición a la publicidad digital durante la pandemia, optimizando estrategias de anuncios en Google/Facebook y utilizando análisis para impulsar mayores conversiones en cursos educativos.

Colaborador de Código Abierto

Jun 2024 - Ahora

Intento contribuir activamente al Código Abierto en mi GitHub

Proyectos

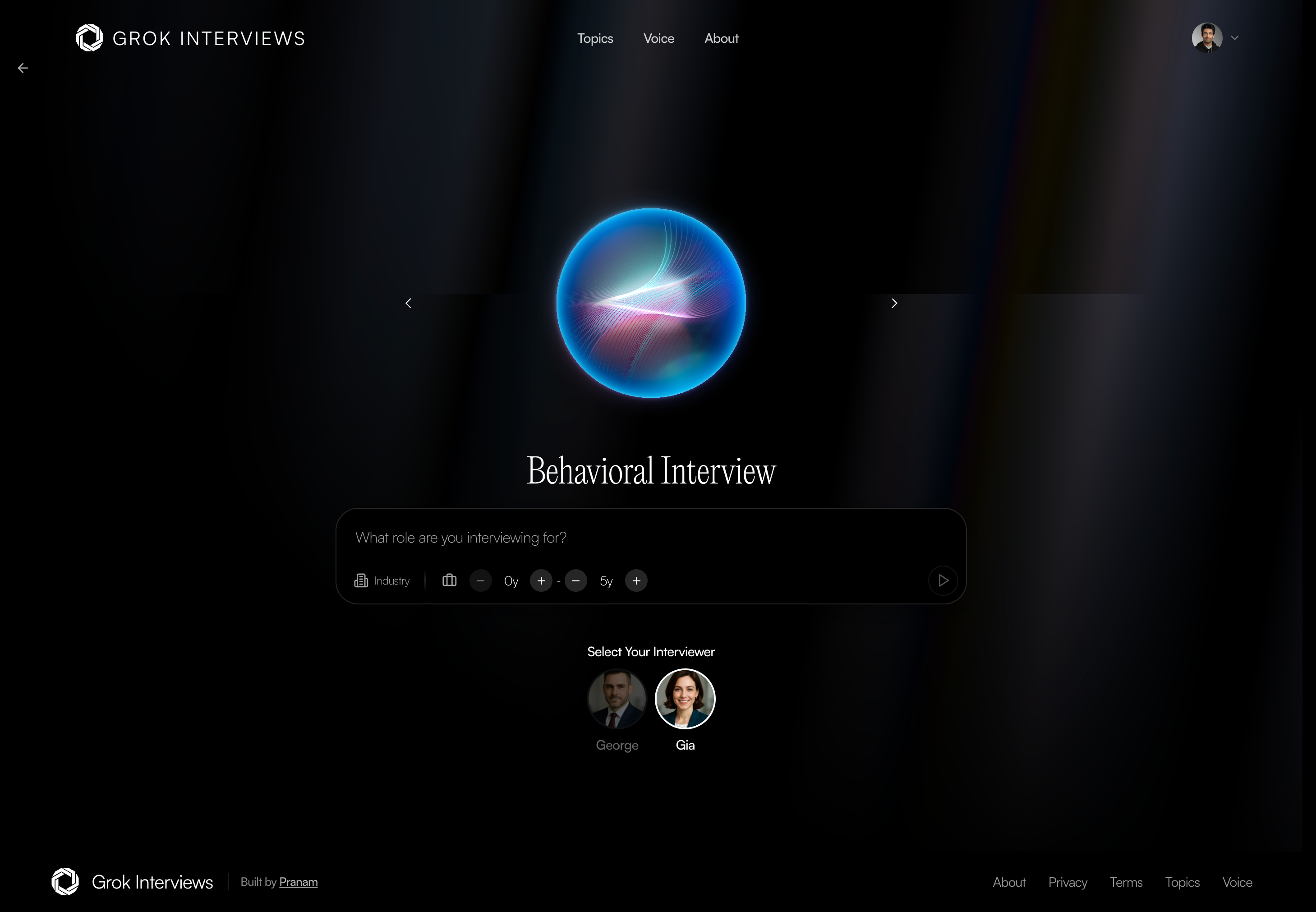

Grok Interviews

Una plataforma integral de preparación de entrevistas de nivel empresarial que cuenta con más de 3,6 millones de recursos seleccionados y 81.499 preguntas técnicas en 5 dominios principales.

Hugo Noir

Un tema limpio y minimalista para Hugo enfocado en la legibilidad, simplicidad y soporte multilingüe.

Blogs

2026-02-03

Planificación Orientada a Agentes: Cómo Hacer que la IA Multi-Agente Funcione Realmente

Los sistemas de IA multi-agente prometen resolver problemas complejos del mundo real, pero solo si el equipo de agentes especializados está coordinado adecuadamente…

2025-09-07

La Atención No Es Todo Lo Que Necesitas. Es Cómo La Necesitas.

Jet-Nemotron repiensa la IA usando atención solo cuando es necesario, aumentando dramáticamente la velocidad y precisión comparado con modelos tradicionales de atención completa.

2025-08-23

¿Son innecesariamente grandes los LLM? Compresión extrema de LLMs usando redes tensoriales inspiradas en la mecánica cuántica

Presenta un nuevo enfoque llamado CompactifAI de Multiverse Computing, que utiliza redes tensoriales inspiradas en la mecánica cuántica para comprimir drásticamente los LLMs con una pérdida mínima de precisión.